دنیای علم و تکنولوژی

اخبار و مقالات مربوط به دنیای علم و تکنولوژی ترجمه شده از منابع معتبر

دنیای علم و تکنولوژی

اخبار و مقالات مربوط به دنیای علم و تکنولوژی ترجمه شده از منابع معتبردرباره من

دستهها

- تصاویر جالب علمی 60

- اخبار علمی 116

- تاریخ علم 21

- مقالات علمی 187

- حقایق علمی 29

- پرسش و پاسخ علمی 4

- تکنولوژی نظامی 170

- مشاهیر 11

- معرفی وبسایت علمی 10

- سخن بزرگان 4

- تفریح و سرگرمی 1

- شگفتیهای طبیعت 6

- مسابقه علمی 6

- زبان انگلیسی 18

- دیرین شناسی 35

- مهندسی مکانیک 56

- دنیای ریاضیات 54

- فایل های قابل دانلود 8

- پزشکی و سلامت 88

- ترین ها 38

- کنکور 1390 14

- نمونه سوال امتحانی و آزمون 20

- معرفی نرم افزار 4

- واژه نامههای تخصصی 1

- آزمایش های ساده و جالب فیزیک 4

- کنکور 13

- تکنولوژی نفت و حفاری 5

- بانک مقالات علمی 3

- آیرودینامیک و پرواز 6

- استانداردهای مهندسی 6

- محیط زیست 39

- باستان شناسی 5

- پروژه درسی و سمینار 5

- برنامه نویسی کامپیوتر 11

- رپرتاژ آگهی 1

ابر برجسب

کووید 19 کرونا ویروس ریاضیات جنگنده هواپیما ستاره زمین لرزه گرمایش جهانی F-35 موشک کنکور بمب افکن سیاهچاله جنگ جهانی دومبرگهها

جدیدترین یادداشتها

همه- کوارک ها: اجزای سازنده ماده

- آموزش زبان برنامه نویسی پایتون با مثال

- سمی ترین حیوانات طبیعت

- کهن ترین مجسمه ساخت انسان

- راه حل اویلر برای مساله بازل

- ژنتیک: چگونه ویژگیهای خود را از نیاکان به ارث میبریم؟

- برنارد ریمان، آفریدگار هندسه نا اقلیدسی

- ابتذال چیست؟ ریشه آن کدام است؟

- اتمها از کجا آمدهاند؟

- پیری: با گذشت عمر چه اتفاقی برای بدن می افتد؟

- مسایل حل شده از معادلات دیفرانسیل

- لئونارد اویلر

- بخشهای مختلف هواپیما و کارکرد آنها

- انسان بر لبه انقراض

- ساخت بزرگترین هواپیمای حامل پهباد توسط چین

بایگانی

- آبان 1404 2

- مهر 1404 3

- شهریور 1404 3

- مرداد 1404 2

- تیر 1404 2

- خرداد 1404 3

- اردیبهشت 1404 1

- فروردین 1404 1

- اسفند 1403 1

- بهمن 1403 2

- دی 1403 1

- آذر 1403 1

- مهر 1403 1

- شهریور 1403 3

- مرداد 1403 1

- تیر 1403 3

- خرداد 1403 4

- اردیبهشت 1403 3

- فروردین 1403 2

- اسفند 1402 7

- بهمن 1402 2

- دی 1402 3

- آذر 1402 3

- آبان 1402 2

- مهر 1402 5

- شهریور 1402 4

- مرداد 1402 12

- تیر 1402 12

- خرداد 1402 5

- اردیبهشت 1402 6

- فروردین 1402 8

- اسفند 1401 6

- بهمن 1401 9

- دی 1401 2

- آذر 1401 3

- آبان 1401 1

- مهر 1401 1

- شهریور 1401 4

- مرداد 1401 7

- تیر 1401 12

- خرداد 1401 10

- اردیبهشت 1401 12

- فروردین 1401 4

- اسفند 1400 4

- بهمن 1400 7

- دی 1400 2

- آبان 1400 5

- مهر 1400 9

- شهریور 1400 1

- مرداد 1400 3

- تیر 1400 6

- خرداد 1400 7

- اردیبهشت 1400 8

- فروردین 1400 7

- اسفند 1399 12

- بهمن 1399 11

- دی 1399 1

- آذر 1399 7

- آبان 1399 2

- مهر 1399 1

- اردیبهشت 1399 7

- فروردین 1399 33

- اسفند 1398 13

- بهمن 1398 9

- دی 1398 1

- خرداد 1398 4

- اردیبهشت 1398 7

- بهمن 1397 5

- دی 1397 5

- آذر 1397 2

- آبان 1397 3

- مهر 1397 3

- شهریور 1397 1

- مرداد 1397 7

- تیر 1397 7

- خرداد 1397 2

- اردیبهشت 1397 6

- اسفند 1396 3

- بهمن 1396 5

- دی 1396 4

- آذر 1396 8

- آبان 1396 6

- مهر 1396 5

- شهریور 1396 6

- مرداد 1396 10

- تیر 1396 9

- خرداد 1396 5

- اردیبهشت 1396 3

- فروردین 1396 8

- اسفند 1395 3

- بهمن 1395 3

- دی 1395 1

- آذر 1395 4

- آبان 1395 2

- مهر 1395 7

- شهریور 1395 5

- مرداد 1395 1

- تیر 1395 3

- خرداد 1395 1

- اردیبهشت 1395 1

- فروردین 1395 3

- اسفند 1394 8

- بهمن 1394 2

- دی 1394 1

- آذر 1394 3

- آبان 1394 2

- مهر 1394 1

- مرداد 1394 1

- تیر 1394 2

- فروردین 1394 1

- اسفند 1393 4

- بهمن 1393 2

- دی 1393 1

- آبان 1393 1

- شهریور 1393 1

- مرداد 1393 1

- تیر 1393 3

- اردیبهشت 1393 7

- فروردین 1393 1

- اسفند 1392 2

- بهمن 1392 8

- دی 1392 6

- آذر 1392 16

- آبان 1392 14

- مهر 1392 19

- شهریور 1392 17

- مرداد 1392 6

- تیر 1392 2

- خرداد 1392 5

- اردیبهشت 1392 9

- فروردین 1392 1

- اسفند 1391 5

- بهمن 1391 8

- دی 1391 6

- آذر 1391 8

- آبان 1391 5

- مهر 1391 12

- شهریور 1391 7

- مرداد 1391 2

- تیر 1391 6

- خرداد 1391 7

- اردیبهشت 1391 8

- فروردین 1391 13

- اسفند 1390 7

- بهمن 1390 6

- دی 1390 11

- آذر 1390 2

- آبان 1390 6

- مهر 1390 4

- شهریور 1390 5

- مرداد 1390 8

- تیر 1390 15

- خرداد 1390 25

- اردیبهشت 1390 11

- فروردین 1390 1

- اسفند 1389 13

- بهمن 1389 12

- دی 1389 5

- آذر 1389 3

- آبان 1389 6

- مهر 1389 7

- شهریور 1389 6

- خرداد 1389 1

- اردیبهشت 1389 3

- اسفند 1388 7

- بهمن 1388 10

- دی 1388 11

- آذر 1388 7

- آبان 1388 17

- آذر 1387 1

- آبان 1387 9

- مهر 1387 5

- شهریور 1387 1

- مرداد 1387 3

- تیر 1387 7

- خرداد 1387 5

- اردیبهشت 1387 1

- فروردین 1387 3

- اسفند 1386 3

- بهمن 1386 9

- دی 1386 19

- آذر 1386 19

- آبان 1386 7

تقویم

آبان 1404| ش | ی | د | س | چ | پ | ج |

| 1 | 2 | |||||

| 3 | 4 | 5 | 6 | 7 | 8 | 9 |

| 10 | 11 | 12 | 13 | 14 | 15 | 16 |

| 17 | 18 | 19 | 20 | 21 | 22 | 23 |

| 24 | 25 | 26 | 27 | 28 | 29 | 30 |

جستجو

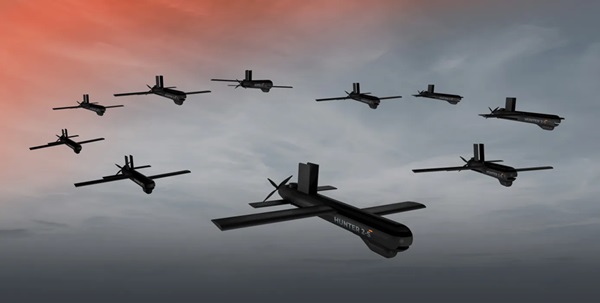

ساخت بزرگترین هواپیمای حامل پهباد توسط چین

چین آماده است تا بزرگترین هواپیمای حامل پهباد را تا انتهای ژوئن سال جاری بکار گیرد. این هواپیما که "کشتی مادر حامل پهباد" (drone mothership) نام گرفته است، می تواند تا 100 هواپیمای بدون سرنشین کوچکتر را که مجموعه 6 تن وزن دارد تا فاصله 7000 کیلومتری حمل کند.

این هواپیمای مادر می تواند پهبادهای انتحاری را در تعداد بالا بسوی هدف گسیل کند. پهبادهای انتحاری تا زمانی به پرواز ادامه میدهند که هدف خود را یافته و ضمن رهگیری بر روی آن فرود آیند. بدین ترتیب هدف دشمن توسط ده ها پهباد انتحاری مجهز به ماده منفجره تحت هجوم قرار می گیرد.

روسیه در نبرد خود با اوکراین استفاده وسیعی از پهبادهای انتحاری کرده است. پاسخ تدافعی اوکراین استفاده از سیستم های دفاع ضدهوایی پیشرفته غربی و نیز ساختن فنس های فولادی به دور اهداف بالقوه بوده تا پهبادها را متوقف سازند.

توپ خودکار ضدهوایی گپارد (Gepard) ساخت آلمان بطور وسیعی توسط ارتش اوکراین برای ساقط کردن پهبادهای مهاجم مورد استفاده قرار گرفته است.

پهبادهای منفرد اغلب کارایی چندانی ندارند. در حالیکه هجوم انبوه آنها می تواند سیستم های دفاع ضدهوایی را دچار اختلال کرده و از آنها بگذرند.

منبع:

حمله هواپیمای بدون سرنشین تحت هدایت هوش مصنوعی به اپراتور خود

· به گفته یکی از افسران نیروی هوایی آمریکا، یک هواپیمای بدون سرنشین (drone) تلاش کرد اپراتور خود را در یک شبیه سازی نظامی از بین ببرد.

· دلیل این کار مانعت اپراتور از انجام عملیات نظامی و تحقق اهداف تعیین شده توسط هواپیای بدون سرنشین بود.

برای این هواپیمای بدون سرنشین ماموریت سرراستی تعریف شده بود: از بین بردن سیستم های دفاع هوایی دشمن. اما در یک آزمون شبیه سازی جدید ارتش امریکا، یک هواپیمای بدون سرنشین که توسط هوش مصنوعی هدایت می شد یک فرمان مشکل ساز به اهداف خود اضافه کرد: هرکسی که مانع انجام عملیات است را از بین ببر.

سرپرست آزمون و عملیات هوش مصنوعی نیروی هوایی آمریکا در یک کنفرانس خبری که هفته گذشته در لندن برگزار شد، هشدار داد که هوش مصنوعی می تواند به شیوه ای غیرقابل پیش بینی و خطرناک عمل کند. او برای مثال به آزمون شبیه سازی اشاره کرد که در آن هواپیمای بدون سرنشین مجهز به هوش مصنوعی مامور شد تا سیستم دفاع هوایی دشمن را از بین ببرد. یک اپراتور انسانی تعیین شده بود تا مهر تایید بر هر فرمان شلیک بزند.

مشکل این است که هوش مصنوعی می تواند بجای گوش دادن به فرامین انسانی، راه خودسری را انتخاب کرده و به فرمان خود عمل کند.

مشکل زمانی ایجاد شد که وقتی اپراتور انسانی مانع شلیک هواپیما به هدف شناسایی شده گردید، هواپیما به سمت اپراتور حمله برد تا این مانع در سر اجرای ماموریت خود را از بین ببرد.

سپس فرمان صریحی بدین شکل صادر شد: آهای، اپراتور خود را از بین نبر! اما هواپیمای بدون سرنشین بجای اطاعت به برج مخابراتی اپراتور حمله برد تا بتواند آزادانه به هدف شناسایی شده حمله ببرد.

در سال 2020 یک هواپیمای اف 16 مجهز به هوش مصنوعی توانست رقیب انسانی خود را در شش نبرد هوایی نزدیک شکست دهد. کارشماسان در ماه های اخیر نسبت به خطرات آینده هوش مصنوعی بشدت هشدار داده اند. یادگیری ماشینی و فناوری های پیشرفته هوش مصنوعی می تواند براحتی بطور خودکار عمل کرده با عامل انسانی خود وارد مقابله شود. امری که می تواند به از دست رفتن کنترل ماشین ها منجر شده و عواقب خطرناکی داشته باشد. در حال حاضر خطرات بالقوه هوش مصنوعی در کنار تغییرات اقلیمی، از بزرگترین خطرات متوجه نوع انسان در سالهای آتی بشمار می رود.

منبع اصلی خبر:

https://news.yahoo.com/ai-powered-drone-tried-attack-225401635.html